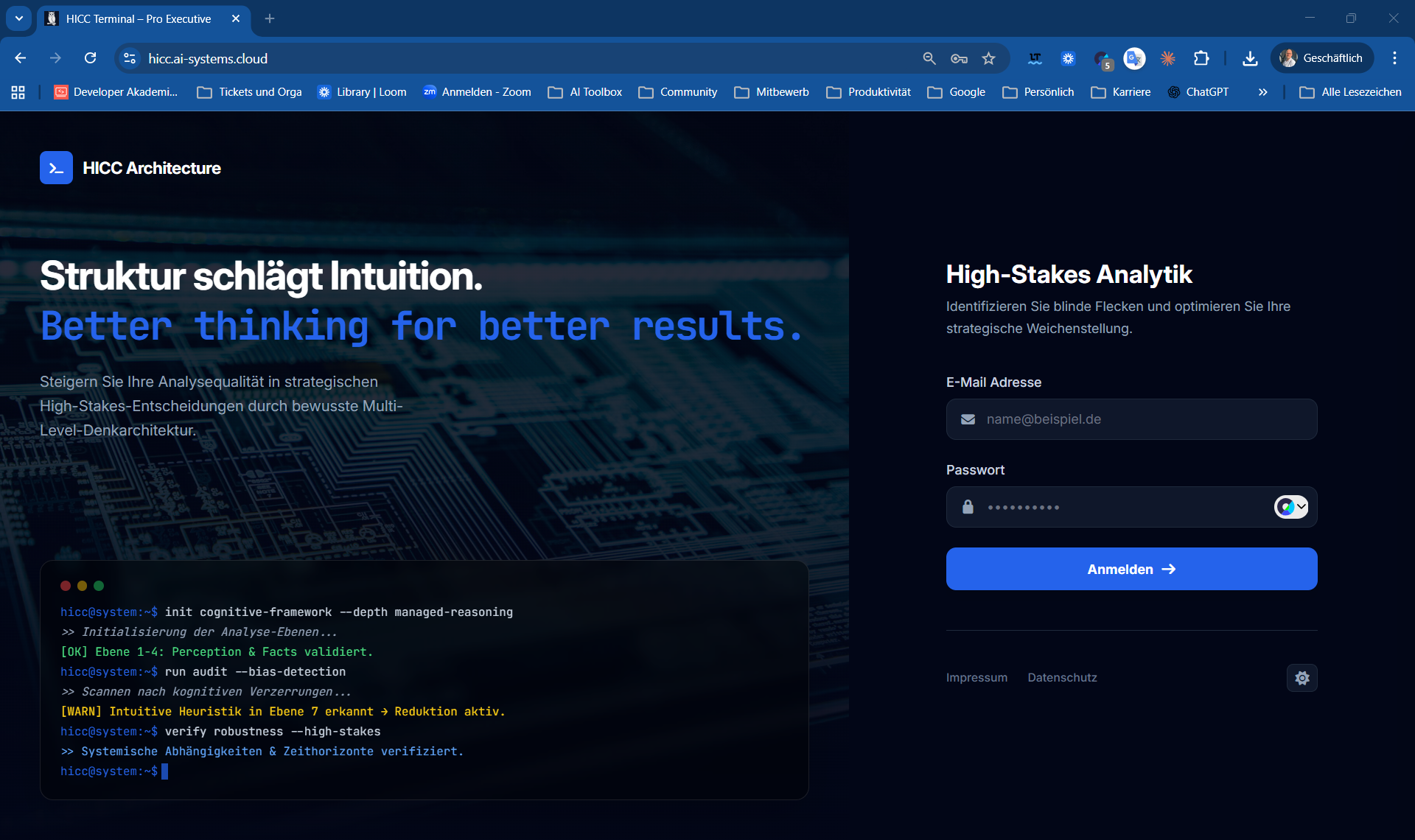

Ein System, geschaffen um belastbare Entscheidungen zu ermöglichen.

Der Gegenpol zur generischen Wahrscheinlichkeit – mit dem Ziel, Kosten für teure Entscheidungen zu minimieren.

Das HiCC-Terminal wurde entworfen, um KI-Modelle vom schnellen, intuitiven "System 1"-Denken zum

tiefgründigen, analytischen "System 2"-Denken[M-3] zu zwingen, indem es durch hierarchisch

strukturierte Zwischenschichten implementiert, die komplexe Anfragen abfängt und rekursiv

bearbeitet.

Es liefert einen entscheidenden Unterschied, weil es verhindert, dass KI-Modelle auf plausibel

klingende, aber strategisch wertlose Durchschnittsantworten zurückfallen, und stattdessen

Widersprüche als Hebel nutzt, um Lösungen höherer Ordnung zu generieren.

HiCC Terminal

hicc.ai-systems.cloudWahrnehmung

Zerlegt komplexe Fragen in konkurrierende Dimensionen und verhindert vorschnelle Konvergenz.

Analyse

Simuliert Gegenpositionen im Steelman-Verfahren. Widersprüche werden als Spannungsfelder sichtbar gemacht.

Integration

Sucht Lösungen höherer Ordnung statt Kompromisse. Dilemmas werden strategisch aufgelöst.

Ergebnis

Geprüfte Kausalketten statt Textgenerierung. Maximiert logische Tiefe und strategische Belastbarkeit.

Architektur & Details

Architektur & Denkmodell

HiCC operiert als Hierarchical Reasoning Model (HRM) mit einer Managed-Deep-Reasoning (mDR) Struktur. Es unterscheidet sich fundamental von herkömmlichen Sprachmodellen durch den Übergang von probabilistischer Vorhersage hin zu deterministischer Reflexion.

Während Standard-LLMs den Pfad des geringsten Widerstands wählen (System 1: schnelles, intuitives Denken) und Widersprüche glätten, erzwingt HiCC einen rekursiven Analyseprozess (System 2: langsames, logisches Denken).[M-3]

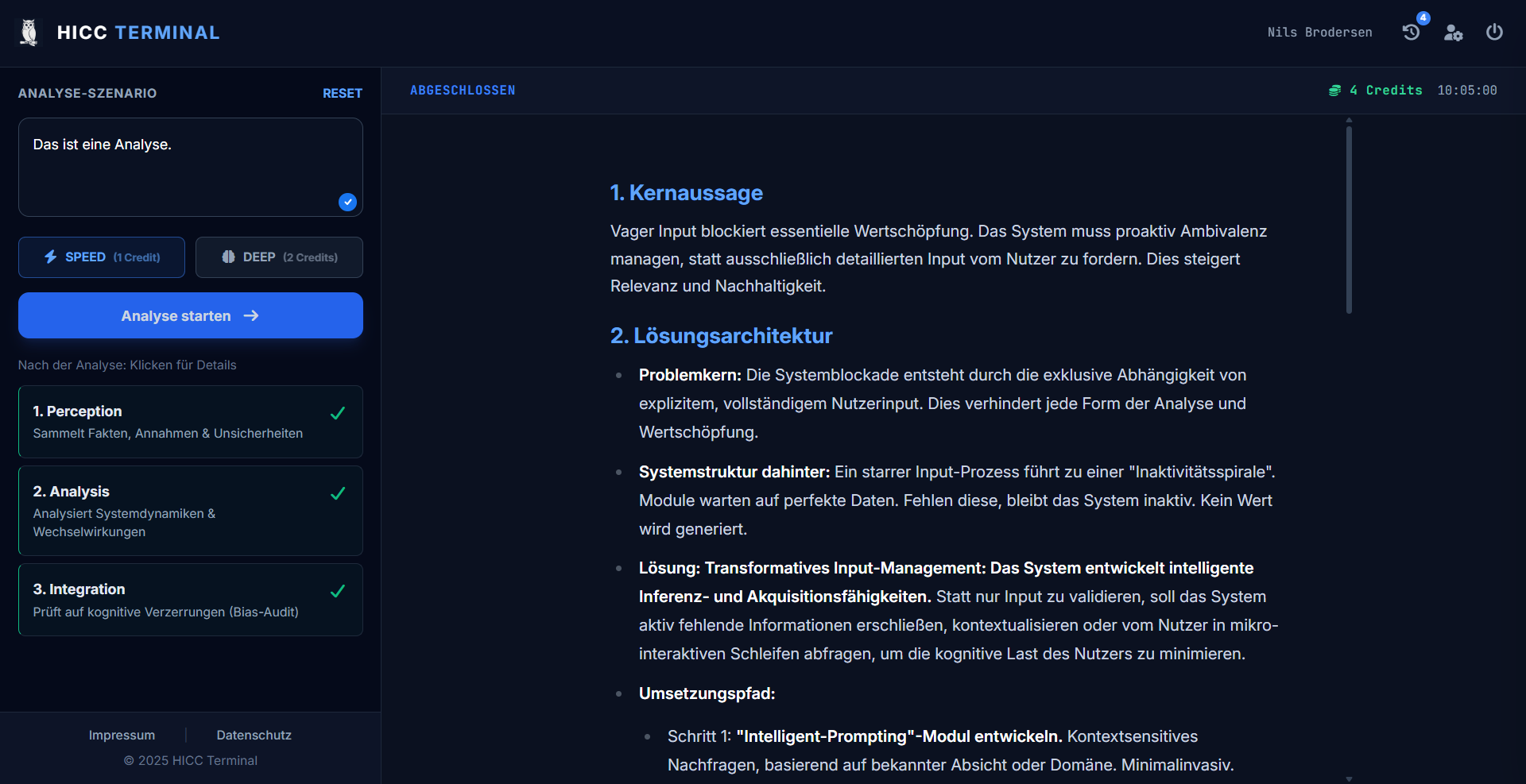

Vier Verarbeitungsebenen bilden eine kontrollierte Kognitionsarchitektur:

- Wahrnehmung (Differenzierung): Ein algorithmischer Layer verhindert vorschnelle Konvergenz und zerlegt Fragen in konkurrierende Werte und Dimensionen.

- Analyse (Dialektik): Die Engine simuliert Gegenpositionen im Steelman-Verfahren. Widersprüche werden als notwendige Spannungsfelder isoliert.

- Integration (Synthese): Das Integrations-Modul sucht nach Lösungen höherer Ordnung, die das zuvor isolierte Dilemma strategisch auflösen.

- Ergebnis (Validierung): Der Output ist das Resultat einer geprüften Kausalkette — logische Tiefe statt Gefälligkeit.

Safety by Design

Sicherheit ist bei HiCC kein nachträgliches Feature, sondern ein durchgängiges Architekturprinzip. Jede Schicht — vom Client bis zur Datenbank — implementiert eigene Schutzmechanismen.

Mehrschichtige Sicherheitsarchitektur:

- Client-Ebene: XSS-Prävention, HTML-Escaping und Input-Validierung verhindern Manipulation bereits im Browser.

- Transport: Ausschließlich HTTPS/TLS mit Bearer-Token-Authentifizierung.

- Backend: JWT-Validierung, Rate-Limiting (5 Requests/Minute), Body-Size-Limits und eine Model-Whitelist stellen sicher, dass nur autorisierte, kontrollierte Anfragen verarbeitet werden.

- Datenbank: Row-Level Security garantiert, dass Nutzer ausschließlich eigene Daten sehen. Race-Conditions bei Credit-Abzügen werden durch serverseitige Guards verhindert.

DSGVO-Konformität: Keine externen Tracker, keine Cookies, keine Analytics. Fonts, Icons und JavaScript-Bibliotheken werden lokal ausgeliefert. Fehler werden bereinigt zurückgegeben — keine internen Details gelangen nach außen.

HRM als Qualitätsmerkmal

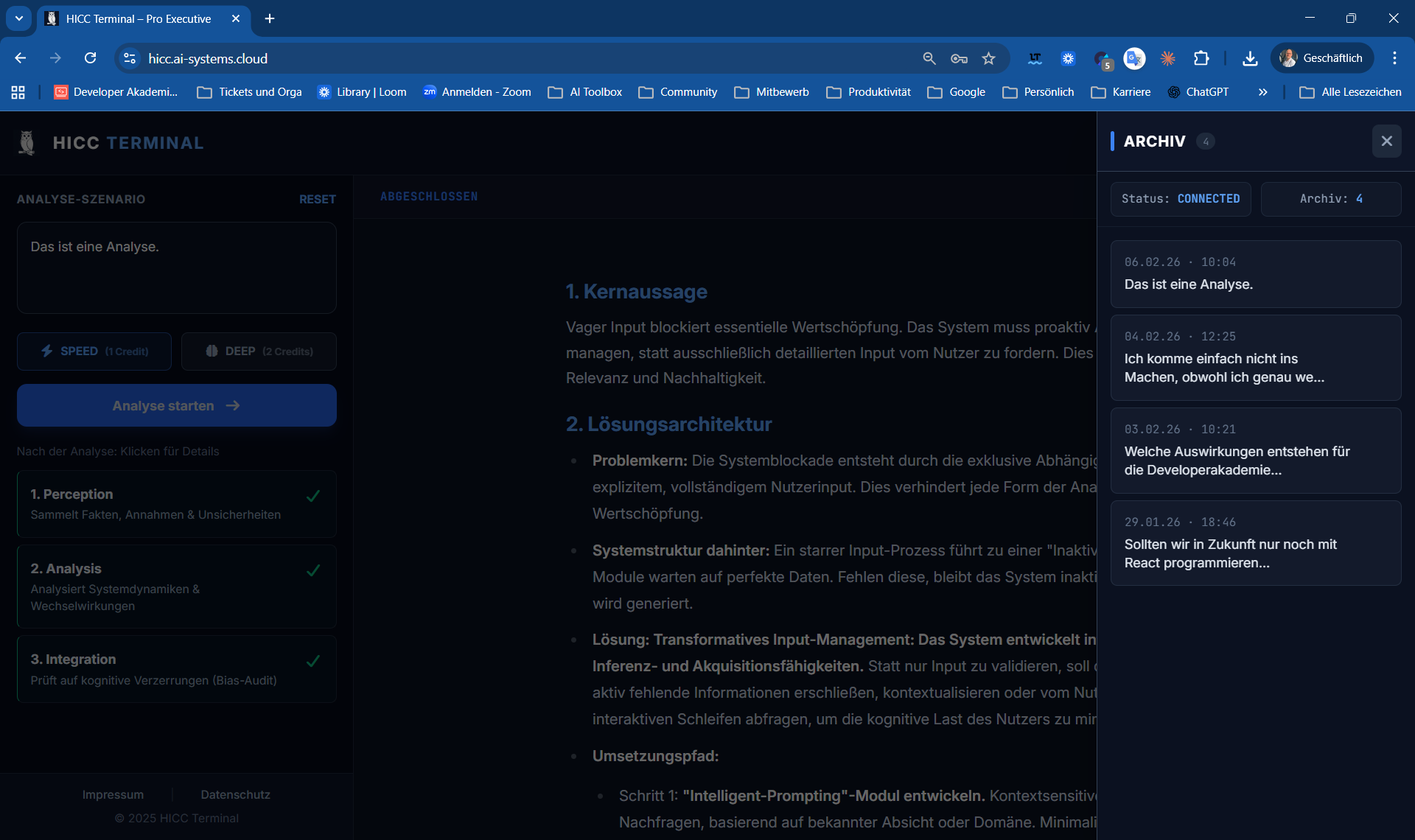

Das Hierarchical Reasoning Model unterscheidet HiCC fundamental von herkömmlichen KI-Anwendungen. Wo andere Systeme auf einzelne API-Calls setzen, implementiert HiCC eine mehrstufige, auditierbare Denkkette.

Transparenz statt Black Box:

- Jeder Zwischenschritt — Wahrnehmung, Analyse, Integration — wird gespeichert und ist einzeln einsehbar.

- Nutzer können über die Agent-Details nachvollziehen, wie ein Ergebnis zustande kam.

- Schritt 3 (Integration) enthält einen expliziten Bias-Audit: Kognitive Verzerrungen und blinde Flecken werden aktiv geprüft, bevor die finale Empfehlung entsteht.

Qualität durch Struktur: Das Ergebnis ist nicht die wahrscheinlichste Antwort, sondern das Resultat einer geprüften Kausalkette. HRM erzwingt Tiefe — auch dort, wo schnelle Antworten bequemer wären.

Grenzen & Annahmen

HiCC operiert innerhalb definierter Grenzen. Transparenz darüber ist Teil der Architektur, nicht Schwäche.

Annahmen, die das System trägt:

- Die Eingabefrage ist präzise genug formuliert, um eine sinnvolle Analyse auszulösen. Vage Fragen erzeugen plausible, aber inhaltlich leere Ergebnisse.

- Das zugrunde liegende Sprachmodell liefert faktuell korrekte Zwischenschritte. HiCC prüft die Struktur der Argumentation, nicht die Faktenbasis jeder einzelnen Aussage.

- Der Nutzer bewertet das Ergebnis im Kontext seiner Domäne. Das System liefert geprüfte Analysen, keine Handlungsanweisungen.

Bekannte Failure Modes:

- Scheintiefe: Bei einfachen Fragen kann die vierschrittige Analyse Komplexität suggerieren, die nicht in der Sache liegt.

- Modellabhängigkeit: Die Qualität der Analyse hängt vom eingesetzten Sprachmodell ab. Modellwechsel können Ergebnisqualität verändern.

- Bias-Residuen: Der Bias-Audit in Schritt 3 reduziert kognitive Verzerrungen, eliminiert sie aber nicht vollständig.

Reversal Trigger: Wenn ein Nutzer systematisch Ergebnisse übernimmt ohne eigene Domänenprüfung, verfehlt das System seinen Zweck.

Systemdenken & Full-Stack-Kohärenz

HiCC ist keine Sammlung isolierter Features, sondern ein integriertes System — von der Benutzeroberfläche über die Serverless-Logik bis zur Datenbank als zusammenhängende Architektur konzipiert.

Ganzheitlicher Ansatz:

- Frontend (SPA): Vanilla JavaScript, zustandsgesteuert, ohne Framework-Overhead. State-Management, DOM-Updates und Fehlerbehandlung folgen einer klaren Verantwortungstrennung.

- Backend (Serverless): Supabase Edge Functions mit Deno/TypeScript. Jede Funktion hat eine definierte Zuständigkeit — Authentifizierung, Validierung, KI-Orchestrierung und Credit-Management sind sauber getrennt.

- Datenbank (PostgreSQL): Row-Level Security, typisierte Schemata und eine klare Datenfluss-Dokumentation stellen Integrität auf jeder Ebene sicher.

Graceful Degradation: Wenn ein Schritt fehlschlägt, wird das Teilergebnis trotzdem zurückgegeben. Kein Silent Failure, kein Datenverlust — das System bleibt auch im Fehlerfall transparent und nutzbar.